Nella SEO tradizionale l’intento di ricerca era un dato: lo dichiarava la keyword. Navigazionale, informazionale, transazionale — tre categorie, tutto classificato. I sistemi AI Search lo rendono dinamico: la stessa intenzione di fondo si esprime in decine di formulazioni diverse, e il sistema le deve riconoscere come equivalenti.

Questo cambia il modo in cui si ottimizza un contenuto. Non si ottimizza più per una query — si ottimizza per la galassia semantica attorno a un intent. Questo capitolo spiega come funziona il query fan-out nei sistemi AI e cosa significa orchestrare l’intenzione in pratica.

Un motore di ricerca tradizionale le tratta come tre query separate, le posiziona su SERP diverse, le serve con contenuti diversi. Un sistema AI Search le riconosce come varianti dello stesso intent — e le risponde con la stessa sintesi autorevole, costruita da fonti che coprono l’intera galassia semantica del tema. La differenza non è nell’interfaccia: è nel modello mentale con cui il sistema legge il bisogno dell’utente.

Questo è il nucleo della trasformazione che questo capitolo esplora. Non come è cambiata la ricerca — quello è già stato analizzato nel capitolo precedente analizzando come l’utente costruisce contesto nelle sessioni AI — ma perché la tassonomia classica dell’intent non basta più, come funziona il query fan-out nei sistemi AI, e cosa significa orchestrare l’intenzione in pratica.

La tassonomia classica dell’intent: perché non basta più

Nel 2002, Andrei Broder pubblicò la prima tassonomia formale dell’intento di ricerca: navigazionale (trovare un sito specifico), informazionale (trovare informazioni) e transazionale (completare un’azione). Per vent’anni, questa classificazione ha guidato la strategia SEO: ottimizza per l’intent della tua query, dai all’utente quello che cerca, vinci il ranking.

Google ha poi raffinato lo schema con le quattro macro-categorie intent — Know, Do, Website e Visit-in-person — codificate nelle Search Quality Rater Guidelines[2]. Uno schema ancora valido come punto di partenza, ma costruito attorno a un’assunzione che nell’era generativa si è incrinata: che ogni query abbia un intent singolo, stabile e dichiarato.

I sistemi AI Search sfidano questa assunzione in tre modi. Primo: la stessa query produce intent diversi a seconda del contesto conversazionale accumulato nella sessione. Secondo: l’AI risponde a un intent inferito — non dichiarato — costruendo un modello probabilistico dell’utente da segnali multipli. Terzo: la risposta AI genera nuovi intent secondari nell’utente che la legge, producendo il conversation loop descritto nel capitolo precedente.

Il risultato pratico: un articolo ottimizzato per l’intent dichiarato di una query — “cos’è il mutuo a tasso variabile” → risposta definitoria — può essere recuperato dal sistema AI anche per query con intent completamente diverso: “quando conviene passare dal fisso al variabile”, “rischio mutuo variabile crisi inflazione”, “differenza spread e Euribor nel mutuo”. Non perché il contenuto sia ottimizzato per quelle query, ma perché copre la galassia semantica che le circonda.

Query fan-out: come l’AI espande ogni ricerca in micro-query multiple

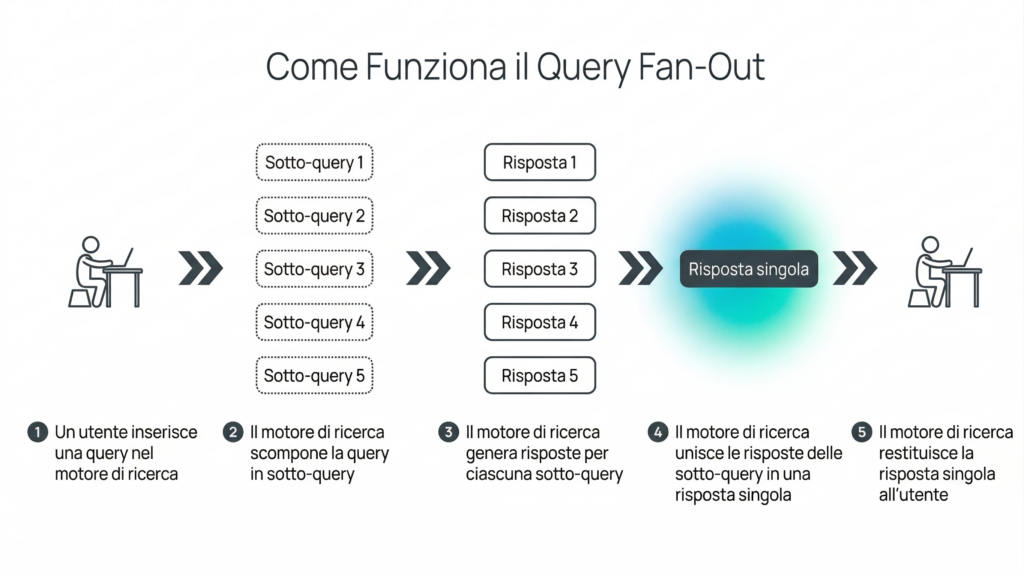

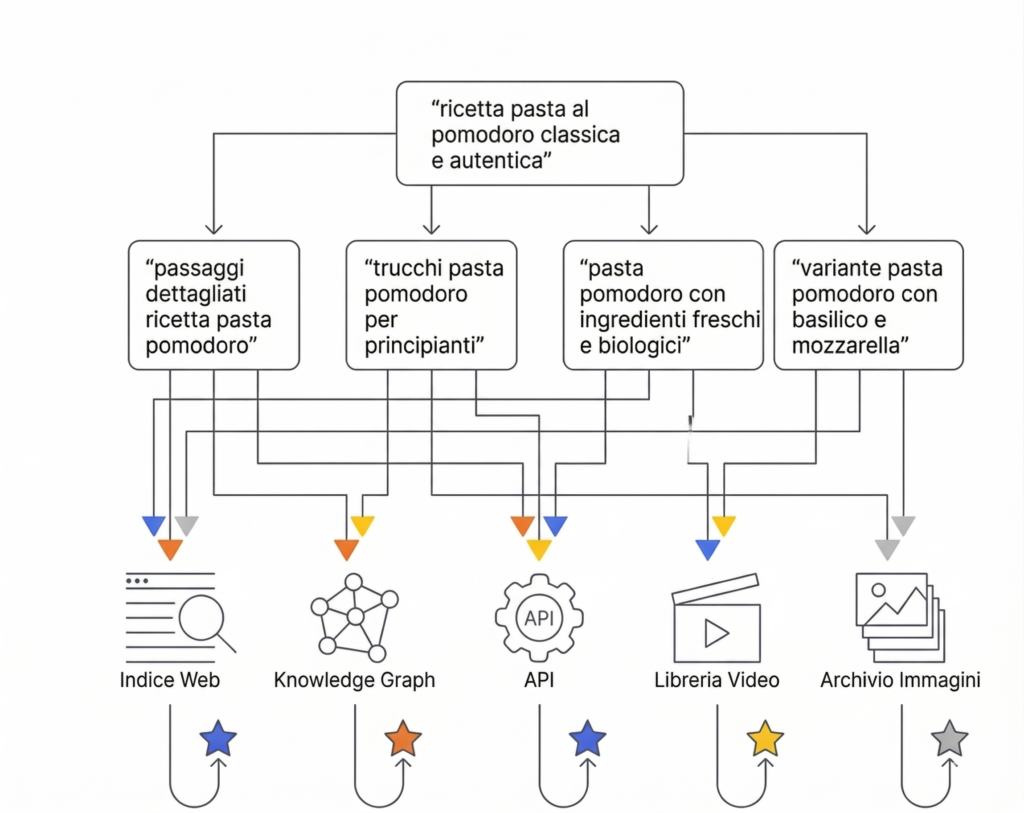

Quando un utente invia una query a Google AI Mode, Perplexity o ChatGPT Search, il sistema non cerca una risposta diretta nel suo indice. Prima scompone la query in una serie di sotto-domande — il cosiddetto query fan-out — che vengono poi processate in parallelo attraverso il meccanismo RAG. Solo dopo aver aggregato le risposte alle micro-query, il sistema sintetizza una risposta coerente da presentare all’utente.

Prendiamo un esempio concreto. La query “come scegliere un’agenzia di content marketing” genera un fan-out che può includere micro-domande come:

- “Quali criteri usare per valutare un’agenzia di content marketing?”

- “Differenza tra content marketing agency e agenzia SEO”

- “Quanto costa un’agenzia di content marketing?”

- “Segnali di un’agenzia di content marketing di qualità”

- “Come misurare i risultati di un’agenzia content marketing?”

Ogni micro-query attiva un processo di retrieval separato. I documenti recuperati vengono poi rerankati in base alla loro rilevanza per la query originale e per il profilo utente. Secondo il paper GEO di Aggarwal et al.[1], i contenuti che coprono più micro-intent della galassia semantica hanno una probabilità di citazione significativamente più alta rispetto a contenuti ottimizzati per una singola query, anche quando questi ultimi raggiungono un ranking organico superiore per quella specifica keyword.

La conseguenza per la strategia di contenuto è radicale: il keyword targeting classico — scegli una keyword principale, ottimizza la pagina per quella keyword, monitora il ranking — cattura solo la superficie del fenomeno. L’ottimizzazione per l’AI Search richiede di mappare l’intera galassia di micro-intent attivabili dalla query e di garantire che il contenuto sia in grado di rispondere a ciascuno di essi in modo auto-contenuto.

Dall’intent statico all’orchestrazione dell’intenzione: il nuovo paradigma

Se il keyword targeting risponde alla domanda “per quale query voglio posizionarmi?”, l’orchestrazione dell’intenzione risponde a una domanda diversa: “quale rete di intenzioni voglio presidiare?”. Non è solo un cambio di vocabolario — è un cambio di struttura mentale nel progettare i contenuti.

Un contenuto ben orchestrato presidia tre livelli di intent contemporaneamente:

- Intent primario: la risposta diretta alla query principale. La definizione, la procedura, il confronto che l’utente ha dichiarato di cercare. Questo è il livello che i tradizionali sistemi di ottimizzazione SEO già gestiscono.

- Intent latenti: le domande che l’utente non ha formulato ma che il sistema AI inferisce dal contesto. “come scegliere un mutuo” attiva latentemente “quali documenti servono”, “quando è troppo presto o troppo tardi”, “quali errori comuni evitare”. Un contenuto che risponde anche a questi latenti viene recuperato per un fan-out più ampio.

- Intent evolutivi: le domande che emergeranno dopo la prima risposta AI, nella fase successiva del conversation loop. Prevedere questi intent e includerne le risposte nel contenuto trasforma la pagina da risposta a libreria di risposte — aumentando drasticamente la probabilità di essere citati in più turn della stessa sessione AI.

L’orchestrazione dell’intenzione è, in pratica, una topical map applicata al singolo contenuto — non al sito. Ogni paragrafo presidia un micro-intent specifico; ogni sezione forma un chunk auto-contenuto che il sistema RAG può estrarre e citare in modo indipendente; il tutto costruisce una copertura semantica completa che rende il documento irrinunciabile per qualsiasi query nell’area tematica.

Questo approccio è il cuore di ciò che il modello tecnico GEO implementa a livello di architettura contenuto. Ma prima di arrivare all’implementazione, è necessario capire come si mappal’intenzione in pratica.

| 📘 Il Manuale Completo della GEO

Stai leggendo il Capitolo 03 di 24 del Manuale AI Search di Instilla. L’analisi completa dell’orchestrazione dell’intento, del query fan-out e delle strategie di visibilità AI è sviluppata capitolo per capitolo. Accedi al Manuale completo → |

Come si mappa la galassia semantica: metodo pratico

Mappare la galassia semantica di una query non richiede strumenti sofisticati — richiede un metodo. Il processo si articola in quattro fasi sequenziali che trasformano una singola keyword in una rete di micro-intent presidiabili.

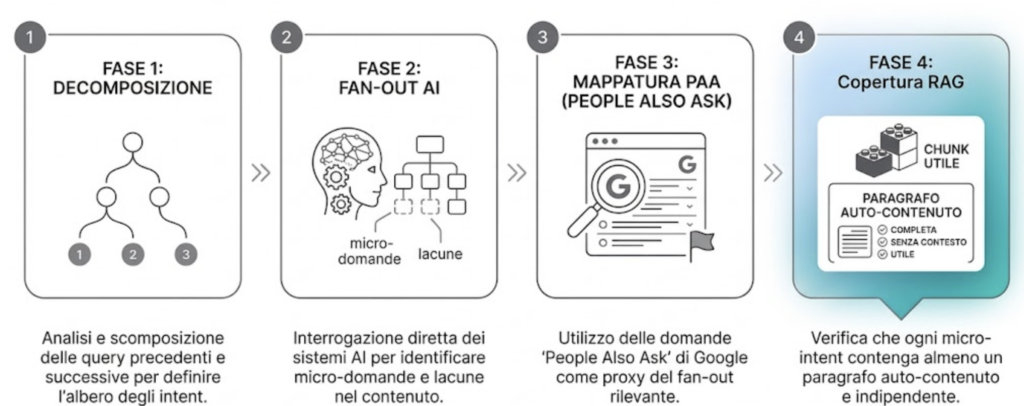

Fase 1 — Decomposizione della query. Parti dalla query principale e chiediti: quali domande deve aver risposto l’utente per formulare questa query? Quali domande formulerà dopo aver letto la tua risposta? Questo produce un albero di intent precedenti (precondizioni) e intent successivi (conseguenze) che definiscono la galassia.

Fase 2 — Analisi del fan-out reale. Interroga direttamente i sistemi AI con la tua query e osserva le fonti che citano. Le micro-domande implicite nella risposta AI sono il fan-out reale che il sistema sta elaborando. Queste sono le lacune da colmare nel tuo contenuto.

Fase 3 — Mappatura delle People Also Ask e delle ricerche correlate. Le domande mostrate da Google nelle sezioni People Also Ask per la tua query principale sono una proxy del fan-out che Google stesso ha identificato come rilevante. Ogni domanda PAA è un micro-intent da presidiare.

Fase 4 — Verifica della copertura. Per ogni micro-intent identificato, verifica che il tuo contenuto contenga almeno un paragrafo auto-contenuto — ovvero un paragrafo che risponda alla micro-domanda senza richiedere il contesto degli altri paragrafi. Questo è il requisito minimo per l’estrazione come chunk utile nel processo RAG.

I livelli di intent e la struttura del contenuto: come costruire chunk efficaci

Comprendere i livelli dell’intent non è sufficiente se la struttura del contenuto non li rispecchia. Il sistema RAG estrae chunk — frammenti di testo di dimensione variabile, tipicamente 80-300 parole — e li valuta in modo indipendente. Un contenuto con intenzione ben orchestrata ma struttura monolitica risulta difficilmente citabile: il sistema non riesce a isolare le risposte ai singoli micro-intent.

La regola fondamentale è: ogni paragrafo deve essere la risposta completa a una micro-domanda specifica. Non deve richiedere il paragrafo precedente per essere comprensibile. Non deve rinviare al paragrafo successivo per completare la risposta. Deve essere un’unità informativa autosufficiente.

In termini pratici, questo significa:

- Evitare pronomi e riferimenti anaforici inter-paragrafo (“come abbiamo visto”, “si tratta dello stesso concetto”, “come spiegato sopra”). Un sistema che estrae il paragrafo in isolamento perde il contesto del riferimento.

- Includere nel primo paragrafo di ogni sezione la definizione o il contesto minimale necessario per capire la risposta anche senza aver letto il resto dell’articolo. Non il riassunto dell’articolo — solo il frame specifico di quella sezione.

- Usare intestazioni semantiche — titoli di sezione che contengano la risposta implicita, non solo il tema. “Il query fan-out nei sistemi RAG” è meglio di “Come funziona la ricerca AI” perché incorpora già la risposta lessicale che il sistema cerca.

- Evitare paragrafi di transizione che non aggiungono informazione. Frasi come “Ora che abbiamo capito X, passiamo a Y” aumentano la lunghezza senza aggiungere valore per il retrieval.

Il sistema di content strategy che mette insieme galassia semantica, struttura a chunk e ottimizzazione per LLM è sviluppato integralmente nel capitolo dedicato a progettare contenuti per la scoperta AI-native. Qui è importante fissare il principio: l’unità base dell’AI Search optimization non è la pagina — è il chunk. E ogni chunk deve presidiare un micro-intent specifico della galassia semantica.

Intent e personalizzazione: quando il contesto dell’utente modifica la risposta AI

Esiste una quarta dimensione dell’intent che rende il sistema ancora più complesso: la personalizzazione contestuale. I modelli AI moderni non solo inferiscono l’intent dalla query — lo calibrano in base alla cronologia della sessione, alla posizione geografica, alla lingua del dispositivo, e — dove disponibile — al profilo accumulato dell’utente.

Questo significa che la stessa query produce risposte diverse a seconda del profilo contestuale dell’utente che la formula. Un brand manager che cerca “come misurare la brand awareness” ottiene un fan-out diverso da uno studente di marketing con la stessa query. Il sistema inferisce il livello di sofisticazione, l’obiettivo probabile, i vincoli operativi.

Per chi ottimizza contenuti, la personalizzazione contestuale ha un’implicazione importante: il contenuto deve essere resiliente alla varianza del profilo utente. Deve rispondere in modo utile sia all’esperto che al principiante, sia a chi ha tempo per approfondire sia a chi cerca la risposta rapida. La struttura a livelli — TL;DR per la risposta immediata, paragrafi dettagliati per l’approfondimento, FAQ per le varianti di intent — non è solo una buona pratica editoriale: è un meccanismo di Personalization Resilience che aumenta la probabilità di essere citati indipendentemente dal profilo dell’utente.

Secondo ricerche di Stanford HAI sui sistemi di raccomandazione AI[4], la capacità di un documento di essere utile a profili utente diversi è uno dei predittori più forti della sua frequenza di citazione nei sistemi conversazionali. La versatilità semantica — copertura di più livelli di intent e di più profili utente nello stesso documento — è un vantaggio strutturale nell’AI Search.

L’intent temporale: come cambia la ricerca nel momento della giornata e del percorso d’acquisto

C’è un ultimo asse dell’intent spesso trascurato: la dimensione temporale. Il bisogno informativo di un utente cambia in base a dove si trova nel suo percorso d’acquisto o decision journey. La stessa persona che oggi cerca “cos’è la GEO” (intent esplorativo) tra tre settimane cercherà “agenzia GEO per PMI Milano prezzi” (intent transazionale). Il contenuto che ha intercettato la fase esplorativa con autorità e utilità ha costruito brand recall che influenza la fase transazionale — anche attraverso il loop AI.

Per l’AI Search, questa dimensione temporale si manifesta nel conversation loop: un utente che ha ricevuto una risposta di qualità su un argomento nella fase esplorativa tende a tornare alla stessa fonte — o alle stesse fonti citate dall’AI — nella fase successiva. Il sistema AI, che tiene conto della cronologia della sessione, referer back alla fonte autorevole già citata. Questo crea un effetto di citation compounding: più volte vieni citato per le query esplorative, più è probabile essere citato per le query decisive.

Come si misura e si monitora questa visibilità nel tempo è il tema della sezione sulla misurazione delle performance GEO nei motori generativi. Ma l’implicazione strategica è già chiara: il contenuto ottimizzato per l’AI Search non si progetta solo per rispondere a una query — si progetta per presidiare un momento del journey e costruire autorità che si trasferisce alle fasi successive.

| 🔬 Analizza la tua visibilità nell’AI Search

Il tuo contenuto copre la galassia semantica delle tue query chiave? Il GEO Rank Simulator di Instilla analizza come appare il tuo contenuto nelle risposte di Google AI Overview, ChatGPT Search e Perplexity e identifica i micro-intent non presidiati. Prova il Rank Simulator gratuitamente → |

Orchestrazione dell’intenzione e topic cluster: la connessione strategica

L’orchestrazione dell’intenzione non si applica solo al singolo documento — ha una dimensione di sito. I topic cluster — gruppi di contenuti semanticamente correlati che ruotano attorno a una pagina pillar — sono la struttura di sito che consente di presidiare intere galassie semantiche in modo distribuito.

In un topic cluster ben costruito, ogni contenuto satellite presidia una o più micro-query della galassia della pagina pillar. Quando un sistema AI elabora un fan-out per una query nell’area tematica del cluster, trova fonti multiple — tutte dello stesso dominio — che coprono micro-intent diversi. Questo produce un effetto di autorità distribuita: il dominio viene riconosciuto come fonte autorevole per l’intera area tematica, non solo per una singola query.

La distinzione rispetto al modello SEO tradizionale è sottile ma importante. Nel SEO classico, il topic cluster serve principalmente a distribuire autorità di link verso la pillar page. Nell’AI Search, il cluster serve a distribuire autorità semantica attraverso la copertura capillare dei micro-intent — indipendentemente dalla struttura dei link interni. Il sistema RAG recupera documenti per rilevanza semantica, non per architettura di link.

Il tema dell’aggregazione delle fonti e della gestione dell’intento latente nei topic cluster è approfondito nel capitolo dedicato al query fan-out e all’aggregazione delle fonti. Quello che è importante capire qui è il principio: ogni contenuto che pubblichi contribuisce alla galassia semantica percepita del tuo dominio dai sistemi AI. La coerenza tematica non è un’opzione — è il meccanismo che costruisce la Generative Authority.

Confronto: keyword targeting vs orchestrazione dell’intenzione

La tabella seguente sintetizza le differenze operative tra il modello SEO classico e il paradigma dell’orchestrazione dell’intenzione per l’AI Search.

| Dimensione | Keyword Targeting (SEO classico) | Orchestrazione dell’Intenzione (AI Search) |

| Unità base | Keyword principale + varianti long-tail | Galassia semantica di micro-intent |

| Struttura contenuto | Pagina ottimizzata per una keyword target | Documento con chunk auto-contenuti per micro-intent |

| Metrica di successo | Posizione in SERP per la keyword target | Citation rate nelle risposte AI per la galassia semantica |

| Strumento di ricerca | Keyword planner, volume di ricerca | Analisi fan-out AI, People Also Ask, conversational gap |

| Profondità copertura | Risposta completa alla query primaria | Risposta a intent primari, latenti ed evolutivi |

| Scalabilità | Lineare: una pagina per keyword cluster | Radiale: un contenuto copre N micro-intent |

Keyword targeting vs orchestrazione dell’intenzione: le differenze operative nel passaggio all’AI Search. Elaborazione Instilla, 2025.

Casi pratici: orchestrazione dell’intenzione in tre settori

Come si applica concretamente l’orchestrazione dell’intenzione? Tre esempi in settori diversi illustrano il principio in azione.

Settore finanziario — query: ‘fondo pensione complementare’. La galassia semantica include intent primari (cos’è, come funziona, tipi), intent latenti (vantaggi fiscali, confronto con TFR, rendimento storico, rischi), intent evolutivi (come aprirne uno, come cambiare fondo, cosa succede se cambio lavoro). Un contenuto che presidia tutti questi livelli viene citato in qualsiasi punto del journey — dalla ricerca esplorativa alla decisione finale. Il conversational gap — i micro-intent non coperti — sono esattamente quello che i competitor occupano nelle risposte AI.

Settore ecommerce — query: ‘macchina caffè espresso casa’. Intent primari: tipologie, caratteristiche, differenze tra sistemi. Intent latenti: confronto prezzi, manutenzione, consumo capsule vs grani, compatibilità. Intent evolutivi: recensioni modelli specifici, dove comprare, garanzia, accessori necessari. Un’azienda che produce solo schede prodotto senza contenuti editoriali informativi perde tutte le fasi pre-transazionali del journey — che nell’AI Search sono anche le più influenti sulla decisione finale.

Settore B2B SaaS — query: ‘software gestione progetto team distribuito’. Intent primari: funzionalità, integrazioni, modelli di pricing. Intent latenti: confronto con competitor, casi d’uso per settore, processo di onboarding, scalabilità. Intent evolutivi: demo, trial, migrazione da altri sistemi, contratti enterprise. I contenuti B2B che presidiano solo le query transazionali perdono la finestra di consideration — il momento in cui l’AI può influenzare la shortlist — che in B2B rappresenta l’opportunità di maggior valore.

Domande frequenti sull’orchestrazione dell’intenzione

Cos’è l’orchestrazione dell’intenzione nell’AI Search?

L’orchestrazione dell’intenzione è l’approccio strategico che supera il semplice keyword targeting per mappare e presidiare l’intera rete di micro-intent attivabili da una query. Nell’AI Search, i sistemi RAG decompongono ogni ricerca in un query fan-out di sotto-domande elaborate in parallelo. Un contenuto che risponde solo alla query principale viene citato una volta; un contenuto che presidia l’intera galassia semantica — intent primari, latenti ed evolutivi — viene citato in più punti del conversation loop dell’utente, costruendo Generative Authority nel tempo.

Che differenza c’è tra keyword targeting e galassia semantica?

Il keyword targeting classico identifica una keyword principale e alcune varianti long-tail, ottimizzando la pagina per posizionarsi su quelle query specifiche. La galassia semantica include invece tutti i micro-intent attivabili nell’area tematica: domande di contesto, domande di approfondimento, varianti di profilo utente, domande pre e post-decisionali. Per un’AI che elabora un query fan-out di 5-10 sotto-domande per ogni ricerca, un contenuto ottimizzato per la galassia semantica ha una probabilità di citazione proporzionalmente più alta rispetto a uno ottimizzato per una sola keyword.

Cos’è il query fan-out e come influenza il mio contenuto?

Il query fan-out è il processo con cui i sistemi AI Search scompongono ogni query in una serie di micro-domande elaborate in parallelo tramite RAG (Retrieval-Augmented Generation). Per ogni micro-domanda, il sistema recupera i documenti più rilevanti, li reranking in base al contesto e li usa come base per la sintesi finale. I tuoi contenuti entrano in gioco non solo se rispondono alla query principale, ma se rispondono a una delle micro-domande del fan-out. Più micro-intent coperti, maggiore la probabilità di essere inclusi nella risposta sintetica dell’AI.

Come si costruisce un chunk auto-contenuto per l’AI retrieval?

Un chunk auto-contenuto è un paragrafo (idealmente 80-200 parole) che risponde in modo completo a una micro-domanda specifica senza richiedere il contesto degli altri paragrafi. I requisiti pratici: evitare pronomi anaforici inter-paragrafo (“come abbiamo visto”, “si tratta dello stesso”); includere la definizione minimale del concetto all’inizio del paragrafo; usare un’intestazione semantica che incorpori la risposta implicita. Un sistema RAG estrae e valuta ogni chunk in isolamento: se il chunk non è comprensibile senza il resto dell’articolo, la probabilità di citazione crolla drasticamente.

Come cambierà l’orchestrazione dell’intenzione nei prossimi anni?

La tendenza è verso sistemi AI sempre più capaci di inferire l’intent implicito — non solo quello dichiarato dalla query, ma quello derivabile da segnali contestuali multipli (cronologia, comportamento, profilo). Per chi produce contenuti, questo significa che la Personalization Resilience — la capacità del contenuto di essere utile a profili diversi — diventerà un fattore competitivo ancora più critico. I contenuti scritti per un solo persona o un solo livello di sofisticazione perdono progressivamente visibilità rispetto a contenuti che coprono la stessa galassia semantica su più livelli di profondità e complessità.

Come posso verificare se il mio contenuto presidia i micro-intent giusti?

Tre metodi pratici. Primo: interroga ChatGPT Search, Perplexity e Google AI Mode con la tua query principale e confronta le fonti citate — se il tuo sito non compare mai, il tuo contenuto non sta copre i micro-intent rilevanti del fan-out. Secondo: esamina la sezione People Also Ask per la tua query in Google — ogni domanda PAA è un micro-intent non presidiato dal tuo contenuto. Terzo: usa il GEO Rank Simulator di Instilla per ottenere una mappa strutturata dei gap semantici. La misurazione sistematica della citation rate è il passo successivo per tracciare i progressi nel tempo.

Appendice A — Motivazione dei link interni

Ogni link interno inserito nell’articolo è documentato qui con la motivazione editoriale e GEO che giustifica il collegamento.

| Anchor → Destinazione | Motivazione |

| «analizzando come l’utente costruisce contesto nelle sessioni AI» → Cap. 02 | Inserito nell’introduzione come bridge con il capitolo precedente. Crea continuità narrativa nel Manuale e distribuisce autorità semantica verso Cap. 02, rafforzando il cluster tematico “comportamento utente → intent → ottimizzazione”. |

| «modello tecnico GEO implementa a livello di architettura contenuto» → Cap. 09 | Posizionato nella sezione sull’orchestrazione dell’intenzione: chi comprende il modello teorico è pronto ad adottare l’implementazione tecnica. Link funzionale che anticipa la Parte III del Manuale con anchor descrittivo del contenuto di destinazione. |

| «progettare contenuti per la scoperta AI-native» → Cap. 11 | Inserito nel paragrafo sui chunk auto-contenuti: la transizione dalla teoria (cos’è un chunk) alla pratica (come progettare contenuti per LLM) è naturale. Distribuisce autorità topica verso Cap. 11 rafforzando il percorso di lettura Parte III. |

| «aggregazione delle fonti e della gestione dell’intento latente nei topic cluster» → Cap. 08 | Posizionato nella sezione topic cluster: il lettore che ha capito l’orchestrazione dell’intenzione ha bisogno di approfondire come il sistema AI aggrega le fonti di un cluster. Link editorialmente giustificato che anticipa la Parte II. |

| «misurazione delle performance GEO nei motori generativi» → Cap. 12 | Inserito nella sezione sull’intent temporale e citation compounding: chi comprende che la visibilità si costruisce nel tempo vuole sapere come misurarla. Crea un content bridge tra la strategia (Cap. 03) e la misurazione (Cap. 12). |

| «misurazione sistematica della citation rate» → Cap. 12 (FAQ) | Seconda citazione a Cap. 12, nella risposta FAQ sulle modalità di verifica. Anchor text variato per evitare duplicazione testuale; focus sul concetto operativo specifico (citation rate) rilevante nel contesto della risposta FAQ. |

Appendice B — Fonti citate

| ℹ️ Nota metodologica sulle citazioni

Le fonti citate in questo articolo includono ricerche accademiche, report di industry e documentazione ufficiale. Il paper Aggarwal et al. [1] è il paper seminale della GEO (arXiv 2308.07525), presentato a NeurIPS 2023. Le Google SQRG [2] sono le linee guida ufficiali per la valutazione della qualità della ricerca, aggiornate a gennaio 2025. I dati SparkToro [3] sono estratti dal report annuale di Rand Fishkin sullo zero-click search. La ricerca Stanford HAI [4] è il report AI Index 2024 sulla personalizzazione nei sistemi conversazionali. |

| # | Autore / Fonte | Titolo / Link | Anno |

| [1] | Aggarwal et al. — Princeton/Georgia Tech | GEO: Generative Engine Optimization | 2023 |

| [2] | Google Inc. | Search Quality Rater Guidelines (Gennaio 2025) | 2025 |

| [3] | SparkToro / Rand Fishkin | Zero-Click Search Study: Where Google Sends (or Doesn’t Send) Traffic | 2024 |

| [4] | Stanford HAI | AI Index Report 2024 — Personalizzazione nei sistemi AI conversazionali | 2024 |