Quando un motore generativo cita il tuo brand, non sta solo aumentando la tua visibilità — sta usando la tua autorità per rispondere a domande reali di utenti reali. Questa catena di responsabilità è spesso invisibile a chi lavora sulla GEO, ma è concreta.

Un’informazione errata o fuorviante amplificata da un motore AI raggiunge più persone, con maggiore credibilità apparente, di quanto potrebbe fare da sola. Chi ottimizza per la GEO ottimizza per essere inserito in questa catena — con tutto ciò che comporta.

Questo scenario non è ipotetico. Accade quotidianamente, con domande di ogni tipo — mediche, finanziarie, legali, di sicurezza. I motori generativi citano le fonti disponibili, non le fonti ideali. E la fonte disponibile sei spesso tu: il brand che ha pubblicato contenuti su quel topic per ragioni di visibilità.

La catena di responsabilità è questa: il brand pubblica contenuti → i motori generativi li estraggono e li amplificano → gli utenti li usano per prendere decisioni. Chi ottimizza per la GEO ottimizza per essere inserito in questa catena. Con questo viene l’obbligo di prenderla sul serio.

La distinzione fondamentale: ottimizzazione vs manipolazione

Esiste una linea chiara — anche se non sempre facile da vedere in pratica — tra ottimizzazione GEO eticamente corretta e manipolazione dei sistemi generativi.

Ottimizzazione legittima: strutturare i contenuti in modo che le informazioni accurate che possiedi vengano estratte e citate facilmente dai motori AI. Usare schema markup per rendere le informazioni più accessibili. Produrre contenuti che rispondono genuinamente alle domande degli utenti. Costruire autorità su topic dove si ha competenza reale.

Manipolazione: produrre contenuti progettati per sembrare autorevoli senza esserlo. Inserire affermazioni fuorvianti in formato altamente citabile. Ottimizzare per query YMYL senza avere le credenziali necessarie. Produrre AI Slop con struttura tecnica perfetta per massimizzare il retrieval su argomenti su cui non si ha esperienza reale.

La differenza non è tecnica — è intenzionale e sostanziale. La domanda da porsi non è “questo contenuto verrà citato?” ma “se viene citato in risposta a una domanda reale, l’utente riceverà informazioni accurate che lo aiutano a prendere una decisione migliore?”

Il framework YMYL applicato alla GEO: standard più alti per argomenti ad alto rischio

Il framework YMYL (Your Money or Your Life) — sviluppato da Google per identificare le categorie di contenuto dove l’inaccuratezza ha conseguenze più gravi — diventa ancora più rilevante nell’era dei motori generativi.

Un contenuto YMYL errato o fuorviante in un risultato di ricerca tradizionale raggiunge un utente che clicca su un link e valuta il contenuto nel suo contesto (sito, autore, data). Lo stesso contenuto citato in una risposta AI viene presentato come parte di una risposta sintetica, con l’autorità implicita del sistema che lo ha scelto come fonte.

Le categorie YMYL principali con implicazioni GEO elevate:

| Categoria YMYL | Esempi di query AI comuni | Standard minimi di accuratezza |

| Salute e medicina | “Sintomi di…”, “come trattare…”, “farmaci per…” | Autore con credenziali mediche verificabili, data di aggiornamento recente, disclaimer appropriati |

| Finanza e investimenti | “Conviene investire in…”, “tasso mutuo…”, “come risparmiare…” | Dati aggiornati, disclaimer su consulenza professionale, fonti verificabili |

| Sicurezza fisica | “Come installare…”, “sicuro fare…”, “emergenza…” | Istruzioni verificate, avvisi di sicurezza espliciti, aggiornamento frequente |

| Aspetti legali | “È legale…”, “diritti del…”, “contratto…” | Giurisdizione specificata, data aggiornamento, invito a consulenza legale |

| Welfare e nutrizione | “Dieta per…”, “supplementi…”, “sviluppo bambino…” | Evidenza scientifica citata, autori con credenziali, nessuna promessa terapeutica |

Per contenuti YMYL, il principio di precauzione si applica in modo più stringente: se non si è sicuri della correttezza di un’informazione, è meglio non pubblicarla come contenuto autonomo ottimizzato per il retrieval AI. È preferibile indirizzare l’utente a una fonte professionale piuttosto che fornire un’informazione parziale amplificata.

Accuratezza come pratica operativa: il protocollo di verifica

L’imperativo etico dell’accuratezza non è solo un principio astratto — richiede processi operativi concreti. Le pratiche fondamentali:

Datazione esplicita: ogni contenuto deve avere una data di pubblicazione visibile e, per contenuti su temi che cambiano rapidamente, una data di ultimo aggiornamento. I motori generativi usano la datazione come segnale di attualità. Un contenuto senza data visibile viene trattato con incertezza.

Revisione periodica strutturata: i contenuti YMYL vanno revisionati almeno una volta all’anno, con processo documentato. La revisione deve includere: verifica dell’attualità dei dati citati, aggiornamento dei link alle fonti, revisione delle raccomandazioni alla luce delle evoluzioni normative o scientifiche.

Disclaimer appropriati: per contenuti YMYL, inserire disclaimer chiari che invitano a consultare professionisti qualificati non è solo una buona pratica legale — è un segnale di affidabilità che i sistemi di valutazione della qualità riconoscono. Un contenuto medico senza disclaimer su consultazione professionale è segnalato come potenzialmente pericoloso dai sistemi di rating.

Autorialità verificabile: ogni contenuto su topic YMYL deve avere un autore identificato con credenziali verificabili. Non un autore generico (“Staff editorial”) ma una persona reale con background documentato nel settore trattato.

La responsabilità algoritmica: quando l’AI amplifica gli errori

Una delle caratteristiche più insidiose dei motori generativi è che amplificano sia la qualità che gli errori delle fonti che citano. Un’informazione corretta citata da un motore AI raggiunge più persone con maggiore credibilità. Un errore citato raggiunge altrettante persone con la stessa credibilità apparente — e spesso è difficile per l’utente distinguere la differenza.

Questo crea una responsabilità algoritmica per i brand: la capacità di diffusione dei propri errori è proporzionale alla propria autorità generativa. Un brand con alta citation rate ha anche alto error amplification potential. Chi ottimizza la propria visibilità nei motori generativi aumenta contestualmente la propria responsabilità verso l’accuratezza.

La risposta non è rinunciare alla visibilità generativa — è costruirla su una base di accuratezza reale, processi di verifica strutturati e cultura aziendale che tratta il contenuto pubblicato come una dichiarazione pubblica con conseguenze.

Trasparenza verso gli utenti: segnali di onestà

Oltre all’accuratezza delle informazioni, l’etica GEO richiede trasparenza verso gli utenti su chi sta parlando, con quali interessi e sulla base di quale expertise.

I segnali di trasparenza che i motori generativi valorizzano — e che gli utenti apprezzano quando presenti — sono:

Identità dell’autore con link al profilo professionale verificabile

Affiliazioni e conflitti di interesse dichiarati esplicitamente (ad es. “questo articolo è scritto dall’azienda X, che offre servizi in questo settore”)

Metodologia descritta quando si presentano dati o analisi originali

Fonti citate con link verificabili, non solo menzioni generiche (“secondo gli esperti”)

Limitazioni riconosciute — cosa il contenuto non copre e perché

Un brand che implementa sistematicamente questi segnali non sta solo rispettando un imperativo etico — sta costruendo i differenziatori di fiducia che i sistemi di valutazione della qualità premiano progressivamente in modo più esplicito.

L’etica come vantaggio competitivo sostenibile

C’è un argomento pragmatico, oltre a quello morale, per trattare l’etica GEO come priorità strategica: i sistemi di valutazione della qualità convergono verso l’onestà.

Google, Perplexity, OpenAI e Microsoft stanno investendo massivamente in sistemi di rilevamento dell’inaccuratezza, della manipolazione e della scarsa affidabilità delle fonti. Le penalizzazioni per contenuti fuorvianti o inaccurati — già presenti nei sistemi di ranking SEO — diventeranno progressivamente più severe nei sistemi di retrieval generativi.

Se stai valutando come applicare la GEO alla tua azienda, puoi esplorare i servizi GEO di Instilla.

Il brand che costruisce la propria visibilità generativa su accuratezza, trasparenza e responsabilità sostanziale verso gli utenti sta costruendo un vantaggio difficilmente replicabile dai competitor che ottimizzano solo tecnicamente. La reputazione di fonte affidabile nei modelli AI non si acquista in sei mesi — ma una volta costruita, è estremamente stabile e difendibile.

Connessioni con il framework di qualità e il futuro della GEO

Il tema dell’etica si intreccia con il problema del Content Collapse e dell’AI Slop del capitolo precedente (→ Cap. 18): produrre contenuto autentico e accurato è sia la risposta all’etica che la strategia contro il Content Collapse. Le due prospettive convergono verso lo stesso imperativo pratico.

Nel capitolo sul futuro della discovery AI-first (→ Cap. 20), vedremo come l’evoluzione dei motori generativi renderà i segnali di affidabilità sempre più centrali nella selezione delle fonti — rafforzando ulteriormente il vantaggio competitivo di chi ha costruito autorità su basi etiche solide.

| ⚖️ Applica il framework etico al tuo piano GEO

Fai questa domanda a ogni contenuto che ottimizzi per il retrieval AI: “Se questo testo viene citato da un motore generativo a un utente che prende una decisione reale, la risposta che riceve è accurata, completa e responsabile?” Se la risposta è sì, ottimizza con fiducia. Se è no, la priorità è migliorare la qualità sostanziale prima dell’ottimizzazione tecnica. |

La governance dei contenuti nell’era AI: un nuovo standard aziendale

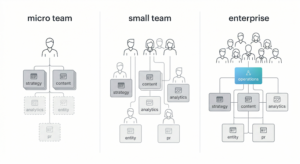

L’imperativo etico della GEO richiede una risposta organizzativa, non solo individuale. Le aziende che producono contenuti su topic YMYL o ad alta responsabilità informativa hanno bisogno di governance dei contenuti adattata all’era AI.

Le componenti fondamentali di una governance dei contenuti orientata alla GEO responsabile:

Policy di accuratezza: criteri espliciti su quale livello di verifica è richiesto per ogni categoria di contenuto prima della pubblicazione. Chi approva, chi verifica le fonti, quale processo di fact-checking è obbligatorio.

Inventario dei contenuti YMYL: registro di tutti i contenuti attivi che rientrano in categorie YMYL, con calendario di revisione e responsabile assegnato.

Protocollo di aggiornamento urgente: processo per aggiornare rapidamente contenuti che diventano inaccurati a seguito di nuove normative, scoperte scientifiche o cambiamenti di mercato.

Formazione continua: i produttori di contenuto devono essere aggiornati sulle responsabilità derivanti dalla visibilità generativa — non solo sulle tecniche di ottimizzazione.

Questa governance non è un overhead burocratico — è la base operativa che rende sostenibile la strategia GEO nel lungo periodo.

Il contributo al bene comune: l’ecosistema informativo dell’AI

C’è una prospettiva più ampia, che va oltre i singoli brand: il ecosistema informativo che i motori generativi costruiranno dipende dalla qualità delle fonti che trovano. Se le fonti disponibili sono prevalentemente AI Slop inaccurato, i motori generativi produrranno risposte di bassa qualità. Se le fonti disponibili sono accurate, aggiornate e responsabili, i motori generativi diventeranno strumenti genuinamente utili.

Ogni brand che investe in contenuto di qualità — accurato, trasparente, verificabile — contribuisce non solo alla propria visibilità ma alla qualità dell’ecosistema informativo globale. È un contributo al bene comune che ha anche un ritorno diretto: un ecosistema informativo di qualità premia le fonti che lo alimentano.

| → Prossimo capitolo: Il Futuro della Discovery AI-First

Il Capitolo 20 (→ Cap. 20) conclude la Parte VI proiettandosi nel futuro: quali tendenze già visibili nei laboratori di ricerca cambieranno la GEO nei prossimi 3 anni, e come prepararsi oggi alle frontiere avanzate della Generative Authority. |

| ❓ FAQ — Domande frequenti sull’etica nella GEO

Qual è la differenza tra ottimizzazione GEO legittima e manipolazione dei motori generativi? L’ottimizzazione legittima struttura in modo accessibile informazioni accurate che il brand possiede genuinamente. La manipolazione produce contenuti progettati per sembrare autorevoli senza esserlo — affermazioni fuorvianti in formato altamente citabile, AI Slop con struttura tecnica perfetta su argomenti senza competenza reale. La distinzione non è tecnica ma sostanziale: il contenuto ottimizzato aiuta realmente l’utente a prendere decisioni migliori? Perché i contenuti YMYL richiedono standard più elevati nella GEO? I contenuti YMYL (Your Money or Your Life — salute, finanza, sicurezza, legale) citati da un motore generativo vengono presentati come parte di una risposta sintetica con l’autorità implicita del sistema. Un’informazione errata raggiunge l’utente con maggiore credibilità apparente rispetto a un link tradizionale. Questo amplifica le conseguenze dell’inaccuratezza, richiedendo autori con credenziali verificabili, aggiornamento frequente, disclaimer appropriati e fonti citate. Come si gestisce la responsabilità quando un contenuto datato viene citato dai motori AI? Il protocollo di gestione prevede: revisione periodica strutturata (almeno annuale per contenuti YMYL), datazione esplicita con data di pubblicazione e ultimo aggiornamento visibile, processo di aggiornamento urgente per contenuti che diventano inaccurati a seguito di nuove normative o scoperte, inventario dei contenuti YMYL con calendario di revisione e responsabile assegnato. I contenuti non aggiornabili tempestivamente vanno rimossi o sostituiti con disclaimer che limitano la loro applicabilità. L’etica GEO è in conflitto con la massimizzazione della visibilità generativa? No — l’etica è il fondamento della visibilità generativa sostenibile. I motori generativi stanno progressivamente rafforzando i sistemi di rilevamento dell’inaccuratezza e della manipolazione. Un brand che costruisce autorità su contenuto accurato e trasparente acquisisce un vantaggio strutturale: la reputazione di fonte affidabile nei modelli AI è stabile e difendibile nel tempo, a differenza di visibilità costruita su ottimizzazioni tecniche senza sostanza. |

Appendice A — Link interni: anchor e motivazioni

| Cap. | Anchor usato | Motivazione editoriale |

| 18 | “problema del Content Collapse e dell’AI Slop del capitolo precedente” | Continuità tematica: l’etica di Cap. 19 e la qualità di Cap. 18 convergono verso lo stesso imperativo |

| 20 | “capitolo sul futuro della discovery AI-first” | L’evoluzione futura dei motori generativi rafforzerà ulteriormente il vantaggio delle fonti etiche |

| 20 | “Capitolo 20” (nel CTA finale) | Invito alla lettura sequenziale all’interno della Parte VI |

Appendice B — Fonti citate

| # | Autore / Organizzazione | Titolo | Anno |

| [1] | Google SQRG | Search Quality Evaluator Guidelines 2025 — YMYL & E-E-A-T | 2025 |

| [2] | Partnership on AI | Responsible Practices for Synthetic Media: A Framework for AI Publishers | 2024 |

| [3] | Reuters Institute | AI, Misinformation and Public Trust: Implications for News Publishers | 2024 |

| [4] | IAB Europe | Ethical Standards for AI-Optimized Content in Digital Marketing | 2024 |