Il paradosso dell’abbondanza: più contenuti, meno valore

Nel 2024, per la prima volta nella storia del web, il volume di contenuti pubblicati giornalmente ha superato la capacità umana di consumarli. Non solo: la qualità media dei contenuti disponibili su qualsiasi argomento è diminuita sensibilmente rispetto a tre anni prima.

Il paradosso è questo: gli strumenti per produrre contenuti non sono mai stati così accessibili, veloci ed economici. Ma l’abbondanza ha distrutto il valore. Quando chiunque può generare in 30 secondi un articolo di 1.200 parole su qualsiasi argomento, l’esistenza di un articolo su un argomento non garantisce più nulla sulla sua qualità.

Questo fenomeno ha un nome: Content Collapse. È il collasso del rapporto tra quantità e qualità dei contenuti online, accelerato dall’adozione di massa degli strumenti di generazione AI. E ha un sottoprodotto specifico: l’AI Slop — termine entrato nell’uso corrente nel 2024 per descrivere contenuti generati massivamente da AI, pubblicati senza supervisione umana significativa, che riempiono il web di testo plausibile ma privo di valore informativo reale.

Per un professionista del marketing digitale, il Content Collapse non è solo un problema culturale: è una minaccia diretta alla visibilità nei motori generativi. I modelli AI devono distinguere fonti affidabili da fonti apparentemente affidabili. Chi produce AI Slop — anche inconsapevolmente — si espone al rischio di essere classificato come fonte non affidabile, con effetti sulla citation rate che si manifestano progressivamente ma in modo difficilmente reversibile.

Anatomia dell’AI Slop: come riconoscerlo (anche nel proprio contenuto)

L’AI Slop non è sempre immediatamente riconoscibile. Non si tratta solo di testo palesemente robotico — i modelli attuali producono testo fluido e grammaticalmente corretto. L’AI Slop si riconosce invece da una serie di caratteristiche strutturali.

| Caratteristica | AI Slop | Contenuto di valore |

| Fonte dell’informazione | Sintesi di fonti pubbliche senza apporto originale | Dati proprietari, esperienze dirette, ricerca originale |

| Prospettiva | “Ci sono pro e contro per ogni posizione” — nessuna tesi difesa | Tesi chiara difesa con argomenti, anche se controversa |

| Specificità | Affermazioni generiche (“è importante”, “dipende dal contesto”) | Dati precisi, contesti specifici, esempi reali con numeri |

| Autore | Nessun autore identificato o autore senza credenziali verificabili | Autore con esperienza documentata nel settore trattato |

| Utilità per il lettore | Risponde alla query ma non aggiunge nulla a ciò che già si potrebbe trovare ovunque | Fornisce insight che il lettore non avrebbe potuto ottenere altrove |

Il test più utile per valutare il proprio contenuto: chiedi a un esperto del settore se questo articolo gli ha insegnato qualcosa di nuovo. Se la risposta è no — se contiene solo informazioni già disponibili ovunque, riformulate in modo fluido — è AI Slop funzionale, indipendentemente da come è stato prodotto.

Come i modelli AI rilevano la qualità: l’evoluzione dei segnali E-E-A-T

I motori generativi non sono ingenui di fronte all’AI Slop. I sistemi di ranking e retrieval si stanno evolvendo rapidamente per rilevare la differenza tra contenuto autorevole e contenuto apparentemente autorevole.

Il framework E-E-A-T (Experience, Expertise, Authoritativeness, Trust) — sviluppato originariamente per le Google Quality Rater Guidelines — è diventato il principale sistema concettuale per valutare la qualità dei contenuti nell’era AI. In particolare, il segnale Experience (Esperienza diretta) è diventato il discriminante più importante.

L’esperienza diretta è l’unica dimensione del contenuto che un modello AI non può simulare convincentemente. Un LLM può scrivere con competenza apparente su qualsiasi argomento — ma non può avere vissuto il problema, commesso errori reali nel risolverlo, o sviluppato intuizioni basate su anni di pratica nel settore. Questi elementi — quando presenti e specifici — sono segnali che i sistemi di valutazione della qualità rilevano come indicatori di autorevolezza autentica.

La conseguenza pratica: il contenuto che sopravvive al Content Collapse è quello che porta il marchio inequivocabile dell’esperienza umana. Non genericamente (“abbiamo molta esperienza nel settore”) ma specificamente: dati raccolti direttamente, errori documentati, casi anomali analizzati, prospettive non ovvie difese con evidenza.

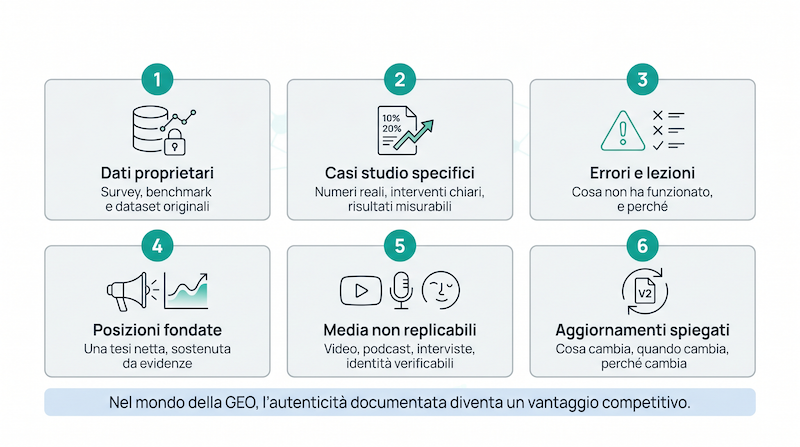

I 6 tipi di contenuto immunizzati dall’AI Slop

Esistono sei categorie di contenuto che per loro natura sono difficilmente replicabili da una pipeline AI non supervisionata. Sono i contenuti a prova di Content Collapse — quelli che diventeranno progressivamente più rari e quindi più preziosi come fonti per i motori generativi.

- Dati proprietari originali: survey condotte internamente, analisi di dataset interni, benchmark basati su dati reali di clienti (anonimizzati). I modelli AI citano dati con fonte quando disponibili — e privilegiano la fonte originale rispetto ai siti che riprendono secondariamente lo stesso dato.

- Casi studio con numeri specifici: non “abbiamo aiutato un cliente a migliorare le performance” ma “abbiamo aumentato il citation rate del cliente X da 12% a 34% in 4 mesi, attraverso questi 3 interventi specifici”. La specificità rende il caso studio non replicabile genericamente.

- Errori documentati e lezioni apprese: i contenuti che descrivono cosa non ha funzionato e perché hanno un profilo di autenticità che i sistemi di valutazione riconoscono. Un post “5 errori che ho fatto ottimizzando per la GEO e cosa ho imparato” contiene segnali di esperienza diretta che un contenuto generativo difficilmente produce.

- Prospettive controverse fondate su evidenza: prendere una posizione netta su un argomento dibattuto nel settore — e difenderla con dati specifici — è qualcosa che i modelli AI tendono a evitare per default (producono invece bilanciamento neutro). Un contenuto che dice “la maggior parte delle agenzie SEO vi sta vendendo GEO fasulla, e questi sono i 4 segnali per riconoscerla” ha un profilo di autorialità forte.

- Contenuti ibridi con media non replicabile: video con dimostrazione pratica, podcast con intervista a un esperto identificato, infografiche basate su ricerca originale. Questi formati portano segnali di autenticità (voce, volto, identità verificabile) che l’AI Slop non può replicare.

- Aggiornamenti con spiegazione del cambiamento: un contenuto che viene aggiornato e spiega esplicitamente “cosa è cambiato rispetto alla versione precedente e perché” dimostra un monitoraggio continuo del settore che è caratteristico di esperti reali, non di pipeline di contenuto automatizzate.

La risposta dei motori generativi: algoritmi anti-slop in sviluppo

I principali motori generativi hanno già avviato o dichiarato lo sviluppo di sistemi per identificare e penalizzare l’AI Slop nelle proprie risposte. I meccanismi sono diversi per piattaforma.

Google AI Overview: ha rafforzato i segnali E-E-A-T nel proprio sistema di ranking, con particolare enfasi sulla verificabilità dell’autore e sulla presenza di dati originali. I Quality Rater Guidelines 2025 hanno introdotto criteri espliciti per identificare contenuti prodotti principalmente da sistemi automatizzati senza supervisione editoriale significativa.

Perplexity: tende a privilegiare fonti con aggiornamento recente e citazioni verificabili. Il suo sistema di retrieval in real-time favorisce organicamente le fonti che aggiornano i propri contenuti con dati freschi — una pratica tipica di chi monitora attivamente il settore, non di chi pubblica batch di contenuti generati.

ChatGPT Search: il modello guida il retrieval con un’attenzione crescente alla source quality. Le fonti con autori identificati e credenziali verificabili ottengono pesi più alti. L’integrazione con Bing Index porta i segnali di qualità dell’indice Bing (inclusa la reputazione del dominio nel tempo) nella selezione delle fonti.

La direzione è chiara: i motori generativi stanno costruendo sistemi sempre più sofisticati per distinguere la qualità reale dall’apparenza di qualità. Chi ha investito in contenuto autentico negli ultimi anni si trova in una posizione difensiva solida. Chi ha investito in volume si espone a una progressiva erosione della visibilità generativa.

La strategia della rarità: produrre meno, meglio

La risposta strategica al Content Collapse non è produrre contenuti anti-AI-Slop in aggiunta al volume esistente — è sostituire il volume con la rarità. Meno contenuti, ciascuno con un livello di qualità e originalità che lo rende citabile per motivi che l’AI Slop non può replicare.

Questo implica un cambio radicale nel processo editoriale. Invece di partire dalla keyword e costruire un contenuto attorno ad essa, il processo inizia da una domanda genuina: “Cosa sappiamo su questo argomento che non si trova già ottimamente espresso altrove?” Se la risposta è “nulla”, non vale la pena produrre quel contenuto.

Il contenuto originale che merita di essere prodotto ha almeno uno di questi elementi: un dato che solo l’azienda ha, un’esperienza che solo quell’autore ha vissuto, un’analisi che richiede competenza specialistica per essere eseguita correttamente, una prospettiva che sfida la narrativa dominante in modo fondato. Se nessuno di questi elementi è presente, il contenuto è candidato all’AI Slop anche se scritto da un essere umano.

Qualità tecnica vs qualità sostanziale: entrambe necessarie

Una distinzione importante: la qualità tecnica GEO (chunk auto-contenuti, schema markup, densità semantica) e la qualità sostanziale del contenuto sono due dimensioni diverse — e sono entrambe necessarie.

Un contenuto con qualità tecnica perfetta ma sostanza vuota è AI Slop ben formattato. Verrà estratto dai sistemi RAG facilmente — ma non sarà citato come fonte autorevole perché non porta informazioni che i modelli non hanno già da centinaia di altre fonti identiche.

Viceversa, un contenuto con qualità sostanziale eccellente ma struttura tecnica inadeguata (paragrafi lunghissimi, nessun schema markup, scarsa densità semantica) rischia di non essere nemmeno raggiunto dai sistemi di retrieval, nonostante il suo valore informativo reale.

La GEO efficace è il punto di intersezione tra le due dimensioni: contenuto che vale la pena citare, strutturato in modo da essere facilmente citabile. Le tecniche descritte nella Parte III del manuale (→ Cap. 09) (ottimizzazione tecnica) servono a massimizzare la visibilità di un contenuto già sostanzialmente di valore — non a creare valore dove non c’è.

Connessioni con il framework E-E-A-T e la content strategy

La sfida della qualità descritta in questo capitolo si affronta con gli strumenti già discussi nelle parti precedenti del manuale. Il framework E-E-A-T applicato ai contenuti GEO (→ Cap. 11) fornisce i criteri specifici per valutare e costruire l’autorevolezza percepita dai modelli. L’imperativo di questo capitolo è di non usare il framework E-E-A-T come lista di spunte tecniche — ma come bussola per decidere quali contenuti vale la pena produrre.

Il reverse engineering della GEO (→ Cap. 15) è anche uno strumento di qualità: interrogare i modelli su quale contenuto userebbero come fonte rivela non solo lacune strutturali, ma anche lacune di sostanza — argomenti su cui il proprio contenuto non porta informazioni che i modelli non hanno già.

| 🔬 Applica il test anti-AI Slop al tuo ultimo contenuto

Prendi l’ultimo contenuto che hai pubblicato. Chiediti: contiene almeno uno di questi elementi? Un dato che solo la tua azienda ha. Un’esperienza diretta documentata. Un’analisi che richiede competenza specialistica. Una prospettiva che sfida la narrativa dominante. Se la risposta è no, non è un problema di come è stato scritto — è un problema di cosa dice. Quella è la soglia da alzare. |

Il vantaggio competitivo del contenuto autentico

C’è una buona notizia nel Content Collapse: il divario di qualità crea opportunità. In un web saturo di AI Slop, i contenuti autentici diventano più rari e quindi più preziosi — sia per gli utenti che per i motori generativi che cercano fonti affidabili.

Le aziende che investono oggi in contenuto autentico — dati proprietari, casi studio reali, autori con credenziali verificabili, prospettive originali — stanno costruendo una barriera competitiva strutturale. Non perché competano sulla quantità, ma perché producono qualcosa che i competitor che si affidano esclusivamente all’AI non possono replicare: l’esperienza reale.

La GEO amplifica questo vantaggio. I motori generativi sono progettati per identificare e citare le fonti più autorevoli per ogni argomento. Un brand che è riconosciuto come la fonte canonica per un topic specifico nel proprio settore — perché ha i dati, i casi studio e gli esperti che nessun altro ha — ha una visibilità generativa che non dipende da ottimizzazioni tecniche: dipende dall’autorevolezza reale.

La responsabilità verso il proprio settore

C’è una dimensione che va oltre la strategia: la responsabilità verso la qualità dell’informazione nel proprio settore. Ogni contenuto pubblicato contribuisce al corpus di informazioni disponibili su un argomento — e quindi alla qualità delle risposte che i motori generativi danno agli utenti che cercano su quel tema.

Un settore il cui corpus digitale è saturo di AI Slop produce motori generativi che danno risposte di bassa qualità su quel settore. Un settore con molte fonti autorevoli, specifiche e aggiornate produce motori generativi che aiutano realmente gli utenti a prendere decisioni informate.

Questo collegamento tra qualità del contenuto prodotto e qualità dell’informazione disponibile agli utenti è il tema centrale del capitolo successivo — l’imperativo morale dell’autorità di brand nell’era dell’AI (→ Cap. 19).

| → Prossimo capitolo: Etica, Verità e Algoritmi

Il Capitolo 19 (→ Cap. 19) approfondisce la dimensione etica: non solo come evitare l’AI Slop per ragioni strategiche, ma perché costruire autorità di brand nell’era AI porta con sé una responsabilità verso la qualità dell’informazione che va oltre i propri obiettivi di marketing. |

| ❓ FAQ — Domande frequenti su Content Collapse e AI Slop

Cos’è il Content Collapse e perché è un problema per la GEO? Il Content Collapse è il collasso del rapporto tra quantità e qualità dei contenuti online, accelerato dall’adozione di massa degli strumenti AI. In questa saturazione, i motori generativi devono distinguere fonti affidabili da fonti apparentemente affidabili. Chi produce AI Slop — contenuti generati massivamente senza supervisione, esperienza reale o apporto originale — si espone a una progressiva riduzione della citation rate man mano che i sistemi di valutazione della qualità diventano più sofisticati. Come si distingue un contenuto di valore dall’AI Slop? Il test più utile: chiedi a un esperto del settore se il contenuto gli ha insegnato qualcosa di nuovo. I contenuti di valore reale hanno almeno uno di questi elementi: dati proprietari originali (non sintesi di fonti pubbliche), casi studio con numeri specifici, errori documentati e lezioni apprese, prospettive controverse fondate su evidenza, media non replicabile (video, podcast con esperti identificati). Se nessuno di questi elementi è presente, il contenuto è candidato all’AI Slop indipendentemente da come è stato prodotto. I motori generativi riescono già a identificare l’AI Slop? Sì, progressivamente. Google ha rafforzato i segnali E-E-A-T nelle Quality Rater Guidelines 2025 con criteri espliciti per identificare contenuti prodotti automaticamente senza supervisione. Perplexity privilegia fonti con aggiornamento recente e citazioni verificabili. ChatGPT Search pesa la qualità della fonte e le credenziali degli autori. La direzione è chiara: i sistemi di valutazione della qualità diventano progressivamente più sofisticati nel distinguere autorevolezza reale da apparente. Qual è il segnale E-E-A-T più importante per difendersi dal Content Collapse? Il segnale Experience (Esperienza diretta) è diventato il discriminante più importante nell’era AI. È l’unica dimensione del contenuto che un modello AI non può simulare convincentemente: l’aver vissuto il problema, commesso errori reali, sviluppato intuizioni basate su anni di pratica. Contenuti con segnali forti di esperienza diretta — dati proprietari, casi anomali, errori documentati — hanno un profilo di autenticità che i sistemi di valutazione riconoscono come indicativo di autorevolezza reale. Produrre meno contenuti di qualità superiore è davvero più efficace per la GEO? Sì, nella maggior parte dei contesti B2B e settori specializzati. La strategia della rarità — un contenuto ogni 2 settimane che porta dati originali o prospettive non ovvie — produce tipicamente un citation rate più alto di 10 contenuti settimanali generici. I motori generativi citano le fonti più autorevoli per topic, non quelle più prolifi che. In mercati consumer con alto volume di query informative, la quantità rimane rilevante — ma deve comunque essere supportata da una base di contenuti di qualità elevata che costruisce la reputazione di fonte affidabile. |

Appendice A — Link interni: anchor e motivazioni

| Cap. | Anchor usato | Motivazione editoriale |

| 09 | “Parte III del manuale” (ottimizzazione tecnica) | Le tecniche tecniche GEO della Parte III servono a massimizzare visibilità di contenuto già di valore — non a crearlo |

| 11 | “framework E-E-A-T applicato ai contenuti GEO” | Il framework E-E-A-T di Cap. 11 fornisce i criteri per costruire autorevolezza percepita dai modelli |

| 15 | “reverse engineering della GEO” | Il reverse engineering (Cap. 15) rivela anche lacune di sostanza, non solo strutturali |

| 19 | “imperativo morale dell’autorità di brand nell’era dell’AI” | Cap. 18 introduce la dimensione etica sviluppata in Cap. 19 |

| 19 | “Capitolo 19” (nel CTA finale) | Invito alla lettura sequenziale del capitolo successivo della Parte VI |

Appendice B — Fonti citate

| # | Autore / Organizzazione | Titolo | Anno |

| [1] | Google / Search Quality Team | Search Quality Evaluator Guidelines 2025 — E-E-A-T Section | 2025 |

| [2] | Originality.ai Research | The State of AI Content on the Web: Volume, Quality and Detection | 2024 |

| [3] | Reuters Institute / Oxford | Digital News Report 2024: AI, Trust and Information Quality | 2024 |

| [4] | Semrush / Search Engine Journal | Content Quality in the Age of AI: What Separates Winners from Losers | 2024 |