La content strategy per gli LLM non è una versione più lunga della content strategy SEO — è una disciplina con principi propri. L’unità di base non è la pagina ma il chunk. La struttura organizzativa non è la keyword map ma il topical cluster. L’obiettivo non è il posizionamento ma la citation rate.

Chi porta una keyword map in un brief GEO ottiene contenuti ottimizzati per il passato. Questo capitolo spiega come progettare contenuti per come i modelli AI cercano, selezionano e citano le fonti.

Il problema non è la qualità dei contenuti. È l’architettura della content strategy: progettata per l’algoritmo di ranking di Google 2018, non per il sistema RAG di Google 2025. Le due logiche sono fondamentalmente diverse. Un piano editoriale costruito per il ranking SEO tradizionale ottimizza ogni pagina per la propria keyword — logica di singolo documento. Un piano editoriale costruito per la scoperta AI-native ottimizza cluster di contenuti correlati per la copertura tematica completa — logica di sistema semantico. Questo capitolo insegna come progettare il secondo a partire dal primo.

SEO content strategy vs AI-native content strategy: le differenze strutturali

| Dimensione | SEO-native | AI-native (LLM) |

| Unità di base | Pagina web ottimizzata per keyword | Chunk semantico auto-contenuto (80-200 parole) |

| Struttura organizzativa | Keyword map per volume e difficoltà | Topical cluster per copertura semantica del dominio |

| Obiettivo primario | Posizionamento SERP (CTR, traffico) | Citation rate nelle risposte AI (visibilità generativa) |

| Logica di ottimizzazione | Singolo documento vs singola query | Sistema semantico coerente vs fan-out di intent |

| Aggiornamento | Opportunistico (nuovo contenuto > revision) | Sistematico (manutenzione prevista nel piano) |

| Metrica di successo | Posizione media, traffico organico | Citation rate, impression su varianti semantiche |

| Ruolo delle FAQ | Opzionale, tattico | Strutturale — copertura sotto-query residue del fan-out |

| Schema markup | Best practice tecnica | Requisito strategico per entity recognition e retrieval |

Confronto strutturale tra content strategy SEO-native e AI-native: le differenze non sono incrementali ma architetturali. Elaborazione Instilla, 2025.

Il principio BLUF: Bottom Line Up Front in ogni sezione

Il principio BLUF — Bottom Line Up Front — è il principio strutturale più importante per la content strategy AI-native. Dice: la risposta deve essere nelle prime due frasi di ogni sezione. Il contesto, le spiegazioni e i dettagli seguono. È il contrario della struttura narrativa tradizionale, che costruisce il contesto prima di arrivare alla conclusione.

La ragione tecnica è chiara: i sistemi RAG estraggono chunk dall’inizio del paragrafo. Un chunk che inizia con la risposta è immediatamente citabile; un chunk che inizia con il contesto richiede che il sistema estragga anche il paragrafo successivo per avere senso — e spesso non lo fa. La struttura BLUF non è solo un’ottimizzazione AI: è anche migliore per gli utenti — chi legge in diagonale trova la risposta subito, chi vuole approfondire continua a leggere.

Esempi pratici di riscrittura BLUF:

| ❌ Struttura tradizionale (contesto prima) | ✓ Struttura BLUF (risposta prima) |

| La scelta di un fornitore logistico è un processo complesso che dipende da molti fattori. Le aziende devono considerare il volume di spedizioni, le destinazioni, i tempi di consegna richiesti e il budget disponibile. Solo dopo aver analizzato tutti questi elementi è possibile valutare quale fornitore sia più adatto. | Per scegliere un fornitore logistico: confrontare i tempi di transito standard (24h, 48h, 72h) per le proprie destinazioni principali, richiedere tariffe volumetriche per i propri range di peso, verificare la copertura geografica nelle zone critiche. Il budget è un vincolo, non il primo criterio di selezione. |

Confronto struttura tradizionale vs BLUF: la versione BLUF è immediatamente estraibile come chunk autonomo dai sistemi RAG. Elaborazione Instilla, 2025.

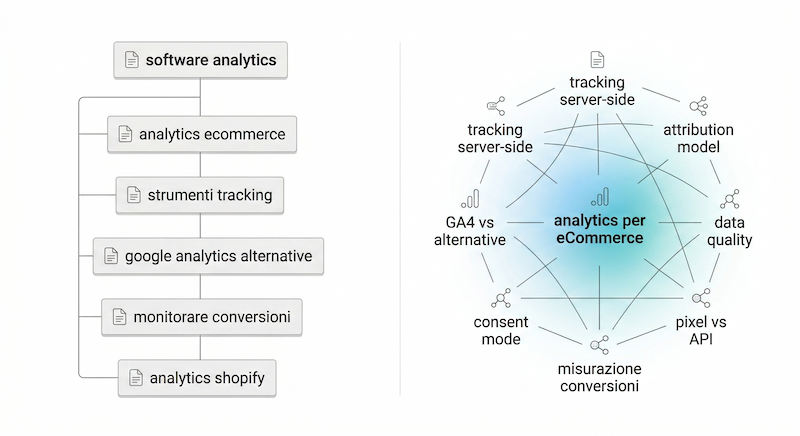

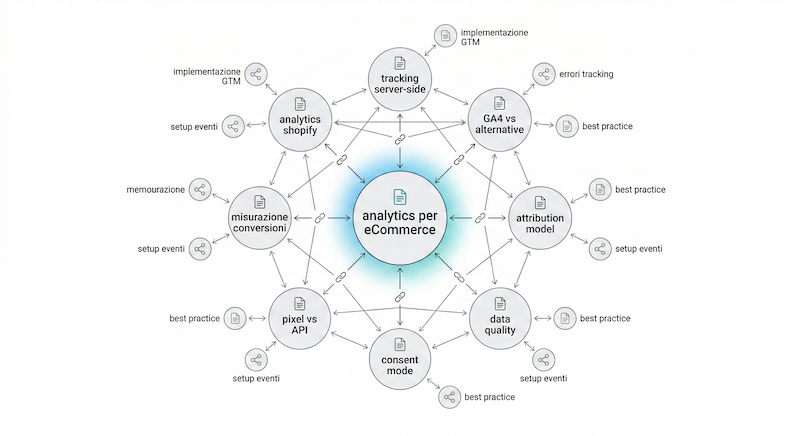

Il topical cluster come unità organizzativa della content strategy AI-native

Il topical cluster è l’evoluzione della keyword map per l’era dell’AI Search. Mentre la keyword map organizza i contenuti per volume e difficoltà di keyword, il topical cluster organizza i contenuti per copertura semantica del dominio: un insieme di contenuti correlati che coprono collettivamente tutto il fan-out di una keyword strategica, con linking bidirezionale e coerenza terminologica tra i pezzi.

Un topical cluster ben strutturato ha quattro componenti:

- Contenuto pillar — l’hub semantico del cluster: 2000-4000 parole, copertura completa del fan-out, struttura galassia semantica. Risponde alla query principale e linkata a tutti i contenuti satellite.

- Contenuti satellite — 5-12 articoli che approfondiscono ogni sotto-query del fan-out: 600-1000 parole ciascuno, struttura BLUF, chunk autonomi, linking bidirezionale con il pillar.

- Contenuti di supporto — case study, dati originali, glossari: costruiscono la Citation Authority del cluster e aumentano il segnale di topical depth per i sistemi AI.

- FAQ e schema markup — una sezione FAQ nel pillar (6-8 domande) e, se rilevante, FAQ dedicate in ogni satellite: coprono le sotto-query residue e alimentano le risposte AI a domande dirette.

La struttura di linking interno nel cluster ha una regola precisa: ogni satellite deve avere almeno un link verso il pillar (con anchor descrittivo del contenuto del pillar, non del suo titolo) e il pillar deve linkare ogni satellite con anchor descrittivo del contenuto del satellite. Questo crea un grafo semantico coerente che i sistemi AI interpretano come segnale di topical authority del dominio.

| 📘 Il Manuale Completo della GEO

Stai leggendo il Capitolo 11 di 24 del Manuale AI Search di Instilla. Come misurare l’impatto di questa strategia di contenuto è sviluppato nei capitoli della Parte IV sul measurement. Accedi al Manuale completo → |

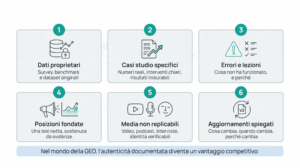

L’angolo di unicità: il principio che distingue i contenuti citati da quelli ignorati

Tra due contenuti ugualmente ottimizzati dal punto di vista tecnico — stessa struttura chunk, stesso schema markup, stesso fan-out coperto — quale viene citato più spesso? Il contenuto con l’angolo di unicità più forte: qualcosa che solo quel brand può dire con credibilità, basato su esperienza diretta, dati proprietari o prospettiva specializzata.

I sistemi AI sono addestrati a preferire fonti con prospettive originali rispetto a contenuti che aggregano informazioni già disponibili altrove. Un contenuto che si limita a sintetizzare le best practice di settore è meno citabile di un contenuto che aggiunge una prospettiva basata su dati reali, casi studio propri o expertise specializzata non replicabile. L’angolo di unicità non deve essere drammaticamente originale — deve essere genuinamente specifico al brand.

Tre fonti di angolo di unicità che ogni brand può sviluppare:

- Dati proprietari. Metriche interne, risultati di progetti, benchmark costruiti su casi reali del proprio settore. Un dato che esiste solo nei propri archivi è automaticamente unico.

- Prospettiva settoriale specializzata. Una visione del mercato che viene dalla specifica esperienza del brand — non generica, ma contestualizzata al segmento in cui opera. Il mercato della logistica B2B in Italia è diverso dalla logistica globale: una prospettiva specifica su quel mercato è già un angolo di unicità.

- Metodologia proprietaria. Un approccio specifico al problema — non solo “cosa fare” ma “come lo facciamo noi, con quali risultati”. Le metodologie con nome (come il protocollo GEO in 7 interventi di Instilla) sono particolarmente citabili perché creano un anchor terminologico unico.

Il piano editoriale AI-native: costruire la mappa dei cluster da zero

Il processo per costruire un piano editoriale AI-native ha cinque passi. Non è un processo lineare — è iterativo, con revisioni basate sui dati di citation rate nel tempo.

Passo 1 — Inventario dei domini di competenza. Elencare le aree tematiche su cui il brand ha competenza reale e documentata. Non più di 5-8 domini per un brand focalizzato — la profondità è più importante dell’ampiezza. Per ogni dominio, verificare se esistono già contenuti e qual è la citation rate attuale.

Passo 2 — Mappatura del fan-out per dominio. Per ogni dominio di competenza prioritario, mappare il query fan-out completo: query principale + 6-8 sotto-query per categoria di intento (il metodo in 4 passi analizzato nel capitolo sull’intento latente e la sua mappatura sistematica). La mappa del fan-out è la struttura del topical cluster.

Passo 3 — Gap analysis. Per ogni sotto-query del fan-out, verificare se esiste già un contenuto che la copre adeguatamente. I gap identificati diventano il backlog editoriale prioritario — ordinati per frequenza di ricerca e rilevanza strategica.

Passo 4 — Definizione del contenuto pillar. Per ogni cluster, identificare o creare il contenuto fondativo: l’articolo che copre il nucleo e i satelliti principali, con struttura galassia semantica, schema markup completo e FAQ di 6-8 domande. Se esiste già un contenuto adatto, può essere ristrutturato; altrimenti va creato da zero.

Passo 5 — Calendario di produzione e manutenzione. Distribuire la produzione dei contenuti satellite nel tempo, con priorità basata sul gap analysis. Pianificare le revisioni periodiche dei contenuti fondativi (ogni 6 mesi) e dei satellite (ogni 12 mesi). Il calendario di manutenzione è parte integrante del piano — non un add-on opzionale.

I formati di contenuto più citati dai sistemi AI: una gerarchia di efficacia

Non tutti i formati di contenuto sono uguali agli occhi dei sistemi RAG. Basandosi sull’architettura di retrieval analizzata nel capitolo sulle differenze architetturali tra le piattaforme AI Search, è possibile costruire una gerarchia di efficacia per formato.

- FAQ strutturate con schema markup — il formato con la maggiore probabilità di citazione diretta, specialmente su Google AI Mode. Ogni risposta è un chunk autonomo con trigger di retrieval esplicito (la domanda). Alta priority: includere in ogni contenuto pillar e satellite.

- Definizioni e glossari — i sistemi AI cercano fonti definitorie per i concetti tecnici. Un glossario del settore con definizioni precise (40-80 parole per termine) è un generatore di chunk altamente citabili per query definitorie.

- Guide step-by-step con schema HowTo — il formato procedurale è il secondo più citato per intent procedurale. Ogni step è un chunk autonomo; il markup HowTo comunica la struttura al sistema AI.

- Tabelle comparative — risponde all’intent comparativo del fan-out. Una tabella X vs Y vs Z è immediatamente estraibile come risposta completa a una query comparativa.

- Dati e benchmark con fonte citata — snippet statistici con dato specifico, fonte e anno sono altamente citabili su tutte le piattaforme, specialmente Perplexity che privilegia affermazioni verificabili.

- Articoli lunghi non strutturati — il formato meno efficace per l’AI Search: senza struttura chunk-friendly, la probabilità di estrazione è bassa indipendentemente dalla qualità del contenuto. Da ristrutturare come priorità.

- Se stai valutando come applicare la GEO alla tua azienda, puoi esplorare i servizi GEO di Instilla.

La manutenzione come componente strategica: il piano di revisione sistematica

Uno degli errori più frequenti nelle content strategy è trattare la manutenzione come attività residuale — qualcosa che si fa quando c’è tempo. Per la content strategy AI-native, la manutenzione è parte integrante del piano: i contenuti non aggiornati perdono citation rate nel tempo, perché i sistemi AI privilegiano contenuti freschi e perché il contesto informativo del settore cambia.

Il piano di revisione sistematica ha tre livelli:

- Revisione trimestrale dei contenuti fondativi — aggiornamento dati quantitativi, verifica link, aggiunta di nuove FAQ per sotto-query emergenti identificate con Search Console. Tempo stimato: 2-3 ore per contenuto.

- Revisione semestrale dei contenuti satellite — verifica coerenza con eventuali aggiornamenti al pillar, aggiornamento date e dati, verifica della copertura del fan-out rispetto alle sotto-query emerse nell’ultimo semestre. Tempo stimato: 1-2 ore per contenuto.

- Audit annuale del cluster — revisione della struttura complessiva del cluster: nuovi contenuti da aggiungere, contenuti obsoleti da aggiornare o consolidare, nuove sotto-query del fan-out da coprire. Produce un piano di produzione per l’anno successivo.

Il framework completo per misurare l’impatto della content strategy AI-native — inclusa la citation rate per cluster e il tracking del divario di misurazione tra SEO tradizionale e GEO — è sviluppato nei capitoli della Parte IV del Manuale.

| 🗂️ Costruisci il tuo piano editoriale AI-native

Hai già una keyword map? Il servizio GEO Content Audit di Instilla analizza il piano editoriale esistente, mappa i gap rispetto al fan-out delle keyword strategiche e produce un piano di conversione da SEO-native ad AI-native con priorità e timeline. Richiedi un GEO Content Audit → |

Domande frequenti sulla content strategy per gli LLM

Cos’è un topical cluster e perché è più efficace della keyword map per l’AI Search?

Un topical cluster è un insieme di contenuti correlati che coprono collettivamente tutto il fan-out di una keyword strategica, con linking bidirezionale e coerenza terminologica. È più efficace della keyword map per l’AI Search perché i sistemi RAG valutano la topical authority — la profondità di copertura di un dominio — non il singolo documento. Un cluster con pillar + 8 satellite per lo stesso dominio tematico segnala ai sistemi AI che il brand è una fonte affidabile sull’argomento, aumentando la probability di citazione per tutte le sotto-query del fan-out, non solo per quella ottimizzata dalla singola pagina.

Cos’è il principio BLUF e come si applica alla scrittura di contenuti?

BLUF — Bottom Line Up Front — è il principio strutturale che prevede di mettere la risposta nelle prime due frasi di ogni sezione, seguita dal contesto e dai dettagli. Si applica riscrivendo ogni paragrafo che inizia con contesto o premessa prima della risposta: identificare la risposta principale, spostarla all’inizio, aggiungere il contesto esplicativo dopo. Il beneficio è duplice: i chunk BLUF sono immediatamente estraibili dai sistemi RAG senza perdere il significato, e migliorano la leggibilità per gli utenti che leggono in diagonale.

Qual è la lunghezza ottimale di un contenuto pillar per l’AI Search?

Un contenuto pillar ottimale per l’AI Search ha 2000-4000 parole, strutturate in sezioni di 80-200 parole ciascuna (la dimensione ottimale del chunk). Non è la lunghezza totale che conta — è la struttura semantica: ogni sezione deve rispondere a una sotto-query specifica del fan-out con struttura BLUF, soggetti espliciti e dati quantitativi. Un pillar da 3000 parole con 15 sezioni mal strutturate è meno efficace di uno da 2000 parole con 10 sezioni ben costruite. La sezione FAQ (6-8 domande con risposte da 60-100 parole) è componente strutturale obbligatoria.

Come si identifica l’angolo di unicità di un contenuto?

L’angolo di unicità è ciò che solo quel brand può affermare con credibilità. Tre fonti principali: (1) dati proprietari — metriche interne, risultati di progetti, benchmark costruiti su casi reali; (2) prospettiva settoriale specializzata — una visione contestualizzata al segmento specifico in cui opera il brand, non generica; (3) metodologia proprietaria — un approccio specifico al problema con nome e risultati documentati. Un contenuto con angolo di unicità forte è preferito dai sistemi AI rispetto a contenuti che aggregano informazioni già disponibili altrove, perché offre una prospettiva non replicabile da fonti alternative.

Ogni quanto va aggiornato un contenuto AI-native?

Il piano di revisione sistematica ha tre livelli: trimestrale per i contenuti fondativi (pillar) — aggiornamento dati, verifica link, nuove FAQ per sotto-query emergenti; semestrale per i contenuti satellite — verifica coerenza con il pillar, aggiornamento date e dati; annuale per l’audit del cluster completo — revisione strutturale con piano di produzione per l’anno successivo. La manutenzione non è un’attività residuale — è parte integrante della content strategy AI-native. Contenuti non aggiornati perdono citation rate nel tempo.

Come si migra un piano editoriale SEO-native a una struttura AI-native?

La migrazione avviene in quattro passi: (1) audit del contenuto esistente — mappare ogni pagina sul fan-out delle keyword strategiche e identificare i gap di copertura; (2) identificare i contenuti riusabili — alcune pagine esistenti possono diventare contenuti satellite dopo ristrutturazione BLUF e aggiunta schema markup; (3) produrre il contenuto pillar mancante per ogni cluster prioritario; (4) costruire il linking bidirezionale tra pillar e satellite. La migrazione non richiede di eliminare il contenuto esistente — richiede di ristrutturarlo e di colmare i gap semantici rilevanti.

Appendice A — Motivazione dei link interni

| Anchor → Destinazione | Motivazione |

| «intento latente e la sua mappatura sistematica» → Cap. 08 | Nel Passo 2 del piano editoriale AI-native (mappatura fan-out): rimando al capitolo tecnico che descrive il metodo di mappatura. Crea continuità tra la dimensione strategica (Cap. 11) e quella tecnica (Cap. 08). |

| «differenze architetturali tra le piattaforme AI Search» → Cap. 07 | Nella sezione sui formati di contenuto: la gerarchia di efficacia è giustificata dall’architettura delle piattaforme. Link di back-reference che collega le implicazioni pratiche alla spiegazione tecnica. |

| «tracking del divario di misurazione tra SEO tradizionale e GEO» → Cap. 12 | Nella sezione sulla manutenzione: rimando al capitolo di misurazione per completare il quadro. Crea il ponte tra la dimensione strategica (Cap. 11) e quella analitica (Cap. 12). |

Appendice B — Fonti citate

| # | Autore / Fonte | Titolo / Link | Anno |

| [1] | Aggarwal et al. — arXiv | GEO: Generative Engine Optimization (arXiv:2308.07525) | 2023 |

| [2] | HubSpot Research | The Topic Cluster Model: The Future-Proof SEO Strategy | 2023 |

| [3] | US Army / BLUF Writing Standard | BLUF: Bottom Line Up Front — Military Writing Standard | 2024 |

| [4] | Semrush Content Marketing Platform | Content Marketing Strategy and Topical Authority Guide 2024 | 2024 |