Un ingegnere che costruisce ponti vuole sapere quali materiali reggeranno il carico — non solo che “i materiali sono importanti”. Lo stesso vale per chi ottimizza contenuti per l’AI Search: conoscere che “bisogna essere rilevanti” non basta. Serve capire come ogni piattaforma misura la rilevanza, quali segnali usa per selezionare le fonti, dove avvengono i punti di decisione nella pipeline.

L’analisi si basa su documentazione pubblica, paper tecnici e comportamenti osservabili. Non tutte le piattaforme documentano la loro architettura con la stessa trasparenza — dove la documentazione è incompleta, i gap sono segnalati esplicitamente. Come si è visto nel capitolo precedente su come funziona il retrieval neurale e la ricerca vettoriale, la base tecnica comune è condivisa — ma le implementazioni divergono in modo significativo.

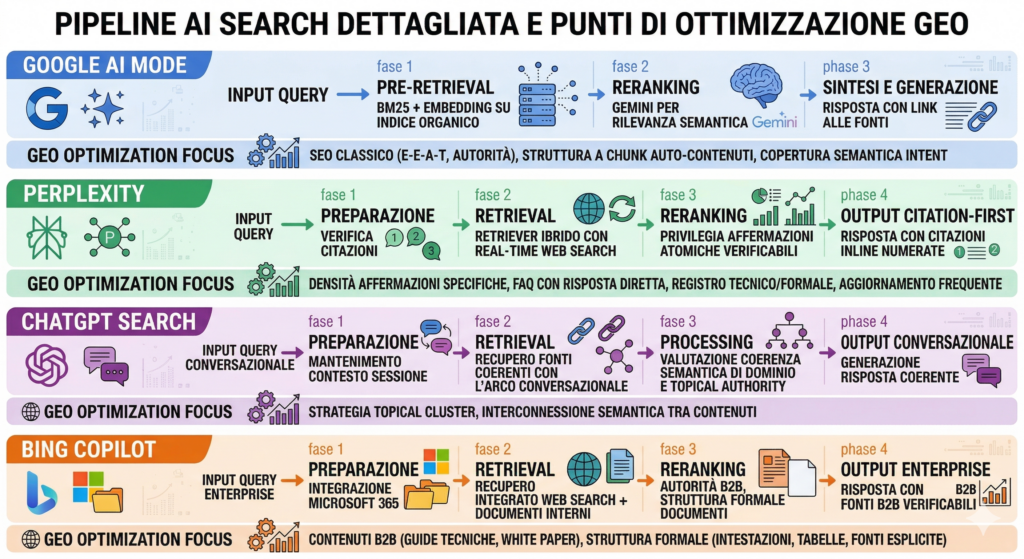

Google AI Mode: architettura ibrida con eredità organica

Google AI Mode non è un motore AI costruito da zero — è l’integrazione di un layer generativo sopra il sistema di ricerca organica più sofisticato del mondo. Questa scelta architetturale ha una conseguenza fondamentale: l’AI Mode eredita tutti i segnali di ranking del Google classico. Un sito con buona autorità di dominio, contenuti E-E-A-T solidi e buon posizionamento organico parte avvantaggiato nell’AI Mode rispetto a un sito sconosciuto all’indice Google — anche se quel sito produce contenuti meglio strutturati per il RAG.

Il processo funziona in tre stadi: (1) pre-retrieval — Google seleziona un sottoinsieme di documenti dall’indice organico usando segnali ibridi BM25 + embedding; (2) reranking con Gemini — il modello multimodale rielabora il sottoinsieme per rilevanza semantica alla query specifica; (3) sintesi — Gemini genera la risposta citando i chunk più rilevanti con link alle fonti. La freschezza del contenuto è un segnale significativo: contenuti aggiornati negli ultimi 90 giorni hanno una probabilità di citazione più alta per query informative, secondo analisi comportamentali di Search Engine Land[1].

Per chi ottimizza: la strategia GEO in Google AI Mode è una estensione del SEO classico, non una sostituzione. Indicizzazione, autorità del dominio e segnali E-E-A-T rimangono fondamentali. Il layer aggiuntivo è la struttura a chunk auto-contenuti e la copertura semantica della galassia di intent correlati — temi sviluppati in dettaglio nel capitolo su come apparire nelle risposte AI attraverso il cuore tecnico della GEO.

Perplexity: architettura citation-first con retriever real-time

Perplexity ha costruito la sua identità sulla trasparenza delle fonti: ogni affermazione nella risposta è accompagnata da una citation inline numerata e linkabile. Questa scelta riflette un’architettura citation-first: il sistema è ottimizzato per selezionare e citare affermazioni specifiche e verificabili, più che per sintetizzare concetti generali.

Il retriever di Perplexity usa una pipeline ibrida con forte componente di real-time web search: a differenza di Google, che attinge principalmente all’indice pre-costruito, Perplexity esegue ricerche web fresche per ogni query significativa. Questo favorisce contenuti recenti e aggiornati. Il reranker privilegia chunk che contengono affermazioni atomiche verificabili — una statistica, una definizione precisa, un dato con fonte — rispetto a paragrafi di contesto generale.

Per chi ottimizza: Perplexity premia contenuti con densità di affermazioni specifiche. Ogni paragrafo dovrebbe contenere almeno un dato quantitativo o una definizione precisa. Le FAQ strutturate con risposta diretta nella prima frase sono particolarmente efficaci. Il profilo utente tipico — professionisti, ricercatori, early adopter tech — suggerisce un registro più tecnico e meno commerciale rispetto ai contenuti ottimizzati per il consumer Google.

ChatGPT Search: architettura conversazionale con coerenza di dominio

ChatGPT Search è il sistema di retrieval integrato in ChatGPT, attivato automaticamente quando il modello rileva che la query richiede informazioni recenti o verificabili. L’architettura è costruita intorno alla coerenza conversazionale: il sistema mantiene il contesto delle domande precedenti nella sessione e recupera fonti coerenti con l’intero arco della conversazione, non solo con la query singola.

La peculiarità dell’architettura è la valutazione della coerenza semantica a livello di dominio: siti con un portfolio di contenuti coerente su un argomento specifico — piuttosto che un singolo articolo eccellente su un sito generico — hanno una probabilità di citazione più alta. Questo premia la topical authority costruita nel tempo, allineandosi con i segnali di autorità tematica che lo stesso Google valorizza nell’indicizzazione.

Per chi ottimizza: ChatGPT Search risponde bene a una strategia di topical cluster — un insieme di contenuti interconnessi che coprono sistematicamente un argomento. Un singolo articolo, per quanto eccellente, ha meno probabilità di essere citato rispetto a un dominio che ha dimostrato profondità tematica su quell’argomento nel tempo. L’interconnessione semantica tra i contenuti del sito rafforza il segnale di coerenza di dominio.

Bing Copilot: architettura enterprise con integrazione Microsoft 365

Bing Copilot è integrato nell’ecosistema Microsoft 365 — Teams, Outlook, Word, Excel — e serve un pubblico prevalentemente enterprise. Questa integrazione ha implicazioni architetturali dirette: il sistema può accedere a documenti interni aziendali (con permessi appropriati) e combinarli con fonti web esterne nella costruzione della risposta.

I criteri di selezione delle fonti in Bing Copilot riflettono il profilo enterprise: autorità del dominio nel settore, struttura formale del documento (report, white paper, guide tecniche), dati quantitativi verificabili e aggiornamento recente. Secondo il Microsoft Work Trend Index 2024[2], il 70% degli utenti enterprise usa già Copilot per ricerche informative nel contesto lavorativo — un segmento con caratteristiche di query molto diverse dal consumer (più specifiche, più tecniche, più orientate alla decisione).

Per chi ottimizza: i contenuti orientati al pubblico B2B — guide tecniche, white paper, report di settore, benchmark — hanno una probabilità di citazione in Bing Copilot superiore a contenuti generalisti. La struttura formale del documento (intestazioni chiare, tabelle dati, fonti citate esplicitamente) è particolarmente rilevante in questo sistema.

Criteri di selezione delle fonti: confronto operativo tra piattaforme

Nonostante le differenze architetturali, i quattro sistemi condividono una base comune di criteri di selezione. Comprendere quali criteri sono universali e quali sono piattaforma-specifici permette di costruire una strategia GEO con una base comune solida e layer di ottimizzazione differenziati.

| Criterio | Google AI Mode | Perplexity | ChatGPT Search | Bing Copilot |

| Autorità dominio | ★★★★★ Fondamentale | ★★★ Rilevante | ★★★★ Importante | ★★★★ Importante |

| Freschezza contenuto | ★★★★ Alta (90gg) | ★★★★★ Molto alta (real-time) | ★★★ Media | ★★★★ Alta |

| Densità affermazioni specifiche | ★★★ Media | ★★★★★ Molto alta | ★★★★ Alta | ★★★★ Alta |

| Struttura chunk answer-first | ★★★★ Alta | ★★★★ Alta | ★★★ Media | ★★★★ Alta |

| Topical authority di dominio | ★★★★ Alta | ★★★ Media | ★★★★★ Molto alta | ★★★★ Alta |

| Dati quantitativi con fonte | ★★★ Media | ★★★★★ Molto alta | ★★★★ Alta | ★★★★★ Molto alta |

Criteri di selezione delle fonti per piattaforma AI Search. Valutazioni qualitative Instilla su documentazione pubblica e comportamenti osservabili, 2025.

| 📘 Il Manuale Completo della GEO

Stai leggendo il Capitolo 07 di 24 del Manuale AI Search di Instilla. Accedi al Manuale completo → |

Strategie di ottimizzazione differenziate per piattaforma

La comprensione delle differenze architetturali permette di definire strategie calibrate. Il principio guida è costruire una base GEO universale — valida per tutte le piattaforme — e aggiungere layer specifici per le piattaforme prioritarie in base al pubblico target.

- Base universale (tutte le piattaforme): chunk auto-contenuti da 80-200 parole, struttura answer-first, densità semantica intorno al concetto principale, almeno un dato quantitativo per paragrafo chiave, FAQ con schema JSON-LD.

- Layer Google AI Mode: aggiornamento regolare del contenuto (ogni 60-90 giorni per argomenti dinamici), segnali E-E-A-T espliciti (autore con bio e credenziali, data di pubblicazione visibile), struttura di linking interno che costruisce autorità tematica nel dominio.

- Layer Perplexity: affermazioni atomiche con dato + fonte in ogni paragrafo chiave, definizioni precise nella prima frase di ogni sezione, registro formale e informativo (ridurre componente commerciale), aggiornamento frequente per sfruttare il retriever real-time.

- Layer ChatGPT Search: strategia di topical cluster — un hub di contenuti interconnessi sulla stessa area tematica, con link contestuali semanticamente coerenti. Un singolo articolo eccellente è meno efficace di cinque contenuti coerenti su un cluster tematico.

- Layer Bing Copilot: struttura formale del documento (tabelle, elenchi, report-style), contenuti orientati alla decisione enterprise (ROI, benchmark, confronti), white paper e guide tecniche con dati verificabili e fonti citate esplicitamente.

La strategia di query fan-out — la tecnica per identificare la galassia di micro-intent associati a ogni query principale — è il tema del capitolo successivo, dedicato a come gestire l’intento latente attraverso il query fan-out e l’aggregazione delle fonti.

| 🔬 Analizza la tua visibilità su ogni piattaforma

Il GEO Rank Simulator di Instilla analizza la tua citation rate su Google AI Mode, Perplexity e ChatGPT Search separatamente, identificando le ottimizzazioni prioritarie per piattaforma. Prova il Rank Simulator gratuitamente → |

Domande frequenti sull’architettura dei motori AI Search

Come funziona Google AI Mode e in cosa differisce dalla ricerca classica?

Google AI Mode è un layer generativo integrato sopra il sistema di ricerca organica classico. Eredita tutti i segnali di ranking del Google tradizionale: autorità del dominio, segnali E-E-A-T, posizionamento organico esistente. Il processo aggiunge un reranking con Gemini e una fase di sintesi che genera una risposta in linguaggio naturale citando le fonti selezionate. La conseguenza pratica: i siti ben posizionati nella ricerca classica partono avvantaggiati anche in Google AI Mode — il lavoro SEO precedente è diventato un prerequisito, non un ostacolo.

Perché Perplexity cita così spesso contenuti specifici rispetto ad altri motori AI?

Perplexity ha un’architettura citation-first: è progettato per identificare e citare affermazioni specifiche e verificabili, mostrandole con citation inline numerata. Il retriever usa una pipeline con forte componente real-time — esegue ricerche web fresche per ogni query — e il reranker privilegia chunk con affermazioni atomiche: una statistica con fonte, una definizione precisa, un dato quantitativo. Contenuti con questa struttura hanno una probabilità di citazione in Perplexity significativamente più alta rispetto a contenuti generici o prevalentemente narrativi.

Cosa si intende per topical authority e perché è importante per ChatGPT Search?

La topical authority è la profondità di copertura di un dominio su un argomento specifico: non una singola pagina ottima, ma un portfolio di contenuti interconnessi che dimostra competenza sistematica. ChatGPT Search valuta la coerenza semantica a livello di dominio — un sito che ha dieci articoli coerenti su un argomento ha una probabilità di citazione più alta di un sito con un singolo articolo eccellente. La strategia per costruire topical authority è il topical cluster: un hub di contenuti con link contestuali semanticamente coerenti tra gli articoli.

Bing Copilot è rilevante per aziende B2B in Italia?

Sì, e la rilevanza cresce con il tasso di adozione di Microsoft 365. Con il 70% di penetrazione di Copilot nelle organizzazioni enterprise, qualsiasi azienda B2B con clienti che usano Microsoft 365 ha un incentivo a ottimizzare per Bing Copilot. I criteri di selezione premiano struttura formale (report, white paper, guide tecniche), dati quantitativi con fonti citate e contenuti orientati alla decisione professionale — esattamente il tipo di contenuti che le aziende B2B dovrebbero già produrre per le loro audience target.

Devo ottimizzare per tutte le piattaforme contemporaneamente?

Non necessariamente. La raccomandazione è costruire una base GEO universale — valida per tutte le piattaforme — e aggiungere layer specifici in base al pubblico target. Se il tuo pubblico è prevalentemente consumer italiano, Google AI Mode è la priorità assoluta. Per pubblico professional o ricercatori, Perplexity merita attenzione specifica. Per B2B enterprise con clienti su Microsoft 365, Bing Copilot è rilevante. La base universale (chunk strutturati, densità semantica, FAQ, dati verificabili) funziona per tutte le piattaforme e deve essere il punto di partenza.

Cos’è la pipeline RAG e come influenza la struttura del contenuto ottimale?

RAG (Retrieval-Augmented Generation) è l’architettura usata da tutti i principali motori AI Search: un sistema che recupera documenti rilevanti e li usa come contesto per generare la risposta. Il contenuto ottimale per una pipeline RAG ha tre caratteristiche: chunk semanticamente autonomi da 80-200 parole, struttura answer-first (la risposta alla micro-domanda è nelle prime due frasi del chunk), e densità semantica intorno al concetto chiave (sinonimi, termini correlati, esempi) per massimizzare la cosine similarity con le query target.

Appendice A — Motivazione dei link interni

| Anchor → Destinazione | Motivazione |

| «come funziona il retrieval neurale e la ricerca vettoriale» → Cap. 06 | Inserito nell’introduzione come aggancio al capitolo precedente: Cap. 06 spiega i principi del retrieval, Cap. 07 li applica alle architetture specifiche. Link di continuità narrativa tra le due parti. |

| «come apparire nelle risposte AI attraverso il cuore tecnico della GEO» → Cap. 09 | Posizionato nella sezione Google AI Mode, dove si accenna alle implicazioni pratiche. Il lettore che capisce l’architettura di Google vuole il framework di ottimizzazione pratica. Link forward verso la Parte III del Manuale. |

| «come gestire l’intento latente attraverso il query fan-out» → Cap. 08 | Inserito alla fine della sezione strategie differenziate: il capitolo successivo approfondisce la gestione dell’intento latente. Link narrativo di chiusura che prepara la transizione. |

Appendice B — Fonti citate

| # | Autore | Titolo / Link | Anno |

| [1] | Search Engine Land | How Google AI Overviews selects sources: ranking signals and freshness analysis | 2024 |

| [2] | Microsoft | Work Trend Index 2024: AI at Work is Here — Now Comes the Hard Part | 2024 |